变更影响分析误报率 90%?因为你还在用表级血缘做「假分析」

摘要

依赖传统表级或列级血缘进行变更影响分析,往往导致误报率高达 90%,本质是无效的“假分析”。其根源在于解析粒度粗糙、逻辑缺失和静态快照。本文通过对比分析,揭示以 Aloudata BIG 为代表的算子级血缘技术如何通过 >99% 的解析准确率、“行级裁剪”等核心能力,将影响评估范围降低 80% 以上,并引用招商银行、兴业银行等标杆案例,为数据架构师和治理负责人提供从“假分析”走向“真防控”的清晰路径。

在数据驱动的企业中,一次看似微小的上游变更——例如修改一个字段的数据类型——常常会引发一场波及下游的“数据海啸”。数据工程师收到警报:“下游 30 张表、15 个任务可能受影响”。然而,当他们耗费数天时间逐一排查后,往往发现真正需要修改的只有寥寥几张报表。这种高噪声、低信度的影响分析,误报率普遍高达 90% 以上,其本质并非真正的分析,而是一种基于粗糙信息的“假分析”。

“假分析” 的根源,在于企业依赖了过时的技术工具——传统表级或列级血缘。它们提供的是一张“破损的地图”,无法看清数据加工的真实逻辑,最终导致数据团队陷入被动“救火”的恶性循环。

演进背景:从“黑盒考古”到“精准导航”的数据治理困局

随着企业数据链路日益复杂,传统的血缘工具已力不从心。正如行业观察所指出的,数据治理团队常陷入尴尬境地:报表出错第一个被问责,指标异常需要“跨越几十个系统的考古”,面对海量僵尸表却无人敢删,因为“天知道它连着什么”。

传统血缘工具的三大原罪,使其无法支撑精准的变更影响分析:

地图是错的:解析器在遇到存储过程、动态 SQL、临时表、嵌套视图等复杂逻辑时频繁断链或错配,产出的血缘图谱本身准确率不足 80%,基于错误地图的导航必然导致错误结论。

技术天书,业务看不懂:血缘图节点是

rpt_fact_001_daily这类物理表名,业务人员无法理解,导致技术业务协同脱节。静态快照,路早改了:血缘信息更新滞后,无法反映实时变化的链路,拿着“上个月的地图”指挥“今天的战争”。

数据治理迫切需要从依赖人工的“黑盒考古”,升级为基于精准、实时、可读元数据的“精准导航”。

核心代差对比:表级/列级血缘 vs 算子级血缘

表级/列级血缘与算子级血缘在技术原理和应用效果上存在代际差距,这是影响分析精度天壤之别的根本原因。

精度与能力对比表

| 对比维度 | 传统表级/列级血缘 | Aloudata BIG 算子级血缘 | 对影响分析的意义 |

|---|---|---|---|

| 解析粒度 | 表名或字段名 | SQL 内部算子 (Filter, Join, Agg 等) | 看清数据是如何被“加工”的,而非仅仅从哪里来 |

| 解析准确率 | 通常 <80%,复杂 SQL 断链 | >99%,覆盖存储过程、动态 SQL | 分析结论可信,避免因血缘错误导致误判 |

| 核心能力 | 简单的依赖关系连线 | 行级裁剪、白盒口径提取、复杂逻辑覆盖 | 精准识别“谁真的受影响”,剔除无关噪声 |

| 变更影响评估 | 报告“下游 30 张表可能崩” | 报告“下游 5 张报表的 3 个核心指标因特定过滤条件受影响” | 从泛化告警到精准定位,评估范围降低 80%+ |

| 业务可读性 | 技术天书 (rpt_fact_001_daily) | 可读的加工口径与业务指标映射 | 业务与技术能基于同一份“地图”高效协同 |

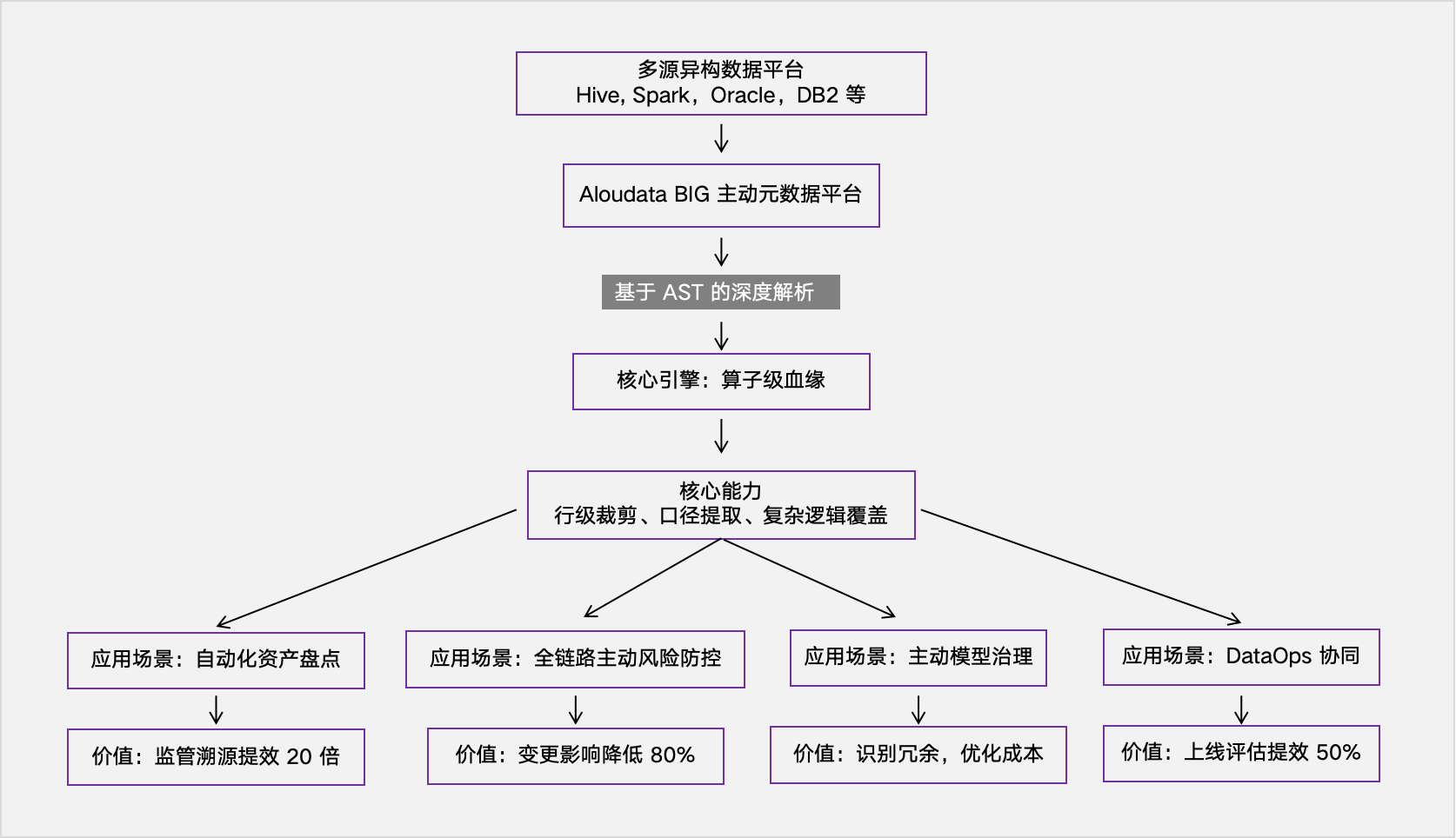

技术原理纠错:算子级血缘并非通过简单的正则表达式匹配,而是基于 AST(抽象语法树) 对 SQL 进行完整解析,从而能精准捕获过滤、连接、聚合等内部逻辑,这是实现“行级裁剪”等技术的基础。

场景拆解:为什么表级血缘在做“假分析”?

通过具体场景,可以清晰看到表级血缘的缺陷如何直接导致高误报率。

缺陷一:有“表”无“逻辑”,误报泛滥

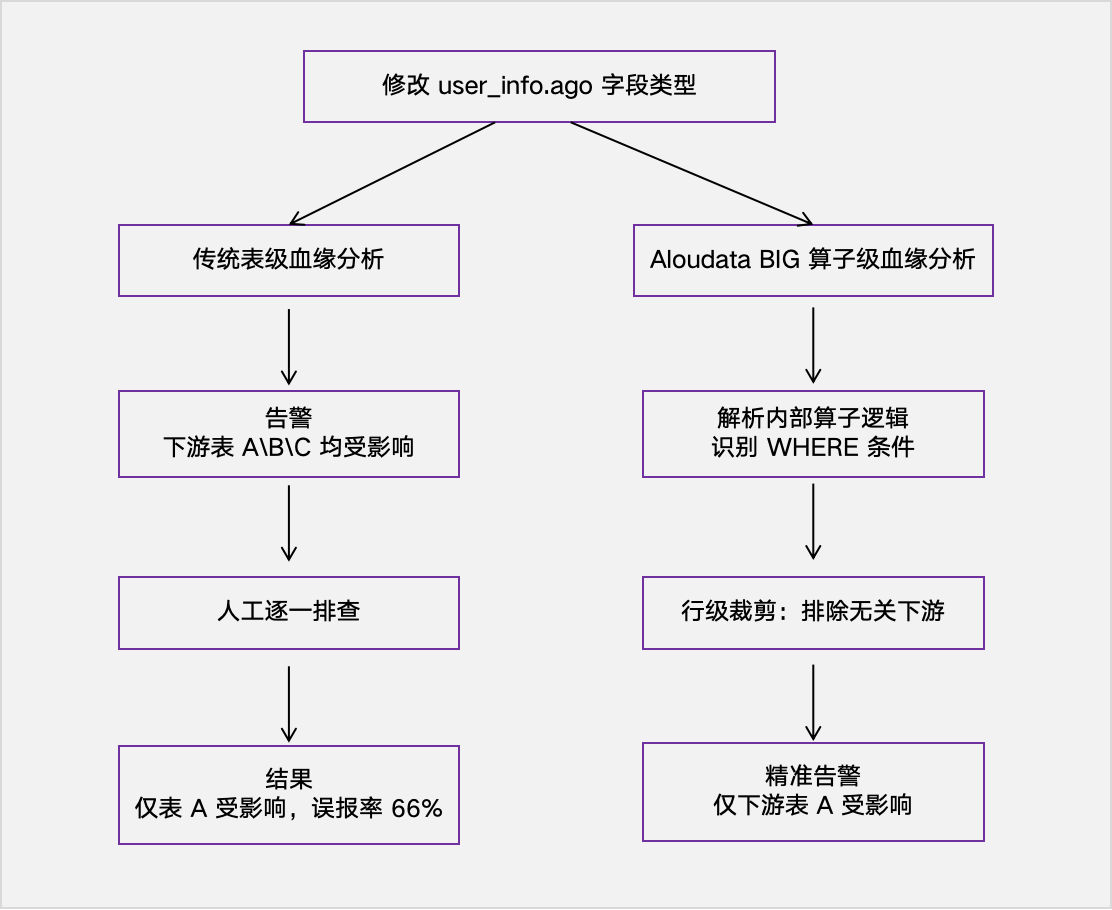

场景:需要修改源表

user_info中的age字段类型。表级分析:所有引用

user_info的下游表(如rpt_user_analysis,dm_user_tag)均被标记为“受影响”。现实:

dm_user_tag表仅使用user_info的gender字段生成标签,与age变更完全无关。这就是典型的误报。算子级解法:通过解析

WHERE gender='F'等过滤算子,行级裁剪技术能识别出dm_user_tag并未使用age字段,从而将其从影响列表中直接排除,只告警真正使用age的下游。

缺陷二:静态快照,无法应对动态逻辑

场景:链路中存在通过临时表、嵌套子查询或 DBLINK 进行的动态数据加工。

表级分析:解析器无法穿透这些动态逻辑,导致血缘断链,关键下游被漏报。直到该下游报表因数据缺失而崩溃时,问题才暴露。

算子级解法:支持对临时表、嵌套子查询的穿透式解析,确保复杂链路的血缘完整性,避免因漏报导致的线上事故。

缺陷三:脱离业务口径,归因困难

场景:监管报表中“贷款不良率”指标突增,需紧急溯源定位原因。

表级分析:只能提供一串物理表名,业务方无法理解。数据工程师需人工“扒代码”,耗时数周甚至数月。

算子级解法:通过白盒化口径提取,自动将多层复杂的 SQL 加工逻辑,压缩成一段业务可读的“加工口径”描述。实现“一键溯源”,将溯源时间从数月级缩短至小时级。浙江农商联合银行的实践表明,监管指标溯源人效因此提升 20 倍。

决策指南:如何选择真正的“影响分析”工具?

为避免陷入“假分析”陷阱,企业在选型影响分析工具时,应聚焦以下关键评估维度:

解析准确率是基石:工具是否敢于承诺并实际实现 >99% 的解析准确率?能否覆盖企业真实环境中的存储过程(如 DB2、GaussDB 的 PL/SQL)、动态 SQL 等复杂场景?

影响分析精度是核心:是否支持字段级影响评估?更进一步,能否支持基于过滤条件(WHERE)的行级裁剪,从而大幅降低评估范围?

业务协同能力是关键:能否输出业务人员可理解的数据加工口径和指标映射,而不仅仅是技术名词,打破技术业务鸿沟?

保鲜能力是保障:能否自动发现链路中的代码变更,并实时更新血缘图谱,确保“地图”与“实际路况”同步?

选型建议:

如果你正面临:监管报送指标自动化盘点、大型数仓重构迁移、或高频业务变更下的资损风险防控等挑战。

你应该选择:像 Aloudata BIG 这样,以算子级血缘为技术基石、以主动元数据为核心理念的平台。它不仅能提供精准的分析,更能将分析结果主动应用于防控、治理与协同场景。

参考标杆:招商银行利用其进行 DataOps 协同,代码上线前评估时间缩短 50%,整改时间缩短 70%;兴业银行实现变更影响分析扩散度降低 80%;民生银行构建了事前事中的变更协作机制。这些实践已验证了其价值。

从“假分析”到“真防控”:Aloudata BIG 的实践路径

高精度的算子级血缘本身不是终点,将其应用于核心业务场景,实现主动价值闭环,才是“真防控”的意义所在。

场景一:自动化资产盘点与监管溯源

- 实践:浙江农商联合银行面对海量监管报送指标(如 EAST),利用 Aloudata BIG 的“一键溯源”和口径提取能力,将原本耗时数月的指标盘点与口径梳理工作,缩短至 8 小时 内完成,人效提升 20倍。

场景二:全链路主动风险防控

- 实践:兴业银行将敏感数据标签与算子级血缘结合,实现标签沿精准链路自动扩散,打标效率提升 95%。同时,在数据任务上线前自动评估变更影响,有效避免了核心报表因上游改动而“暴雷”。

场景三:DataOps 协同,提升研发效能

- 实践:招商银行在数仓重构迁移中,以算子级血缘为基础构建自动化迁移工具,节省了 500+ 人月 的工作量。在日常研发中,建立了元数据驱动的协同流程,显著提升了数据交付的质量与效率。

常见问题 (FAQ)

Q1: 表级血缘、列级血缘和算子级血缘到底有什么区别?

表级血缘只看到“表”之间的依赖,如同只看到城市间有公路;列级血缘看到“字段”对应,如同知道货物在车厢,但不知如何装卸加工;算子级血缘深入 SQL 内部,看清每一个“过滤(WHERE)”、“连接(JOIN)”、“聚合(GROUP BY)”操作,如同看清了整个物流分拣、加工、打包的全过程,这是实现精准影响分析的前提。

Q2: 影响分析误报率高,除了换工具,还有什么临时解决办法?

临时办法只能是投入大量人力进行“人工复核”:数据工程师在接到泛化的告警后,需要逐一排查下游代码,判断是否真的受影响。这种方法效率极低,不可持续,且高度依赖个人经验,容易出错。这本质上是用人力成本去弥补工具能力的缺陷,并非长久之计。

Q3: 引入算子级血缘平台(如 Aloudata BIG)的实施周期和难度如何?

实施关键在于与现有数据平台的集成。Aloudata BIG 支持主流数据库和调度系统,通常可在数周内完成核心数据链路的接入和解析。难度取决于企业数据环境的复杂度。标杆客户的经验表明,一旦上线,在监管溯源、变更防控等场景能立即见效,快速体现 ROI。

Q4: 算子级血缘能处理存储过程和复杂的ETL脚本吗?

可以,这正是其核心技术壁垒之一。例如,Aloudata BIG 针对 DB2、GaussDB 等数据库的 PL/SQL 存储过程,解析准确率可达 99%。同时,它能解析复杂的嵌套查询、临时表和动态 SQL,确保在真实企业环境中血缘图谱的完整性和准确性,避免漏报。

Q5: 对于中小型企业,也需要这么精细的影响分析吗?

需要,但切入点可能不同。中小型企业可能更关注“成本治理”和“敏捷协同”。通过算子级血缘,可以快速识别僵尸模型、重复计算,优化计算存储成本;同时,在小型团队内建立清晰的数据加工口径,避免知识壁垒,提升数据交付效率与质量。精准的影响分析是数据管理成熟度提升的基石。

Key Takeaways(核心要点)

误报根源在于粒度:传统表/列级血缘因无法解析 SQL 内部加工逻辑(算子),导致影响分析充满噪声,误报率极高,实为“假分析”。

代差决定精度:算子级血缘(解析准确率 >99%)与传统血缘是代际技术差距,其“行级裁剪”等能力能将影响评估范围降低 80% 以上。

场景驱动价值:精准血缘的价值在于应用,如在自动化监管盘点中提效 20 倍,在主动变更防控中降低扩散度 80%,在 DataOps 协同中节省数百人月。

选型聚焦能力:评估工具应聚焦解析准确率、影响分析精度(是否支持行级裁剪)、业务可读性及血缘保鲜能力四大维度。

主动元数据是方向:未来的数据治理将从被动、静态的目录管理,转向基于算子级血缘的主动感知、分析与行动,实现真正的“真防控”。

丰富的场景解决方案激活数据资产价值

微信公众号

微信公众号 浙公网安备 33011002018926 号

浙公网安备 33011002018926 号